به گزارش روابط عمومی پژوهشگاه فرهنگ و اندیشه اسلامی، نخستین جلسه از کارگاه دانشافزایی “هوش مصنوعی” با موضوع مروری بر معضل شکاف مسئولیت در هوش مصنوعی و راهکارهایی برای توسعه مسئولانه آن، توسط هسته حکمرانی و هوش مصنوعی مرکز رشد و خانه خلاق و نوآوری پژوهشگاه به صورت مجازی برگزار شد.

در پی توسعه سیستمهای اجتماعی-تکنیکی، توزیع مسئولیت ناشی از پیامدهای این سیستمها به مسئلهای نظری و عملی تبدیل شده است. مسئله توزیع مسئولیت یا مسئولیتپذیری زمانی ایجاد میشود که به علت نقشآفرینی پیچیده عوامل متعدد انسانی و تکنیکی در ایجاد یک عمل، نتوان بهسادگی معین کرد چه کسانی و تا چه حد بابت وضعیت پیشآمده مسئول هستند. این مسئله با ظهور فناوریهای هوش مصنوعی شکل جدیدی پیدا کرده است؛ زیرا فناوریهای هوش مصنوعی میتوانند طیف وسیعی از وظایف را تقریبا بدون دخالت انسانها انجام دهند و خود به عنوان گزینهای برای عاملیت و مسئولیت اخلاقی مطرح باشند. درنتیجه در مورد این فناوریها مسئله توزیع مسئولیت به مسئله شکاف مسئولیت تبدیل میشود؛ یعنی شرایطی که در آن هیچ انسانی را نمیتوان مسئول دانست.

با توجه به تحولات شگرفی که توسط هوش مصنوعی در حوزههای مختلف بهوجود آمده است، هسته حکمرانی و هوش مصنوعی مرکز رشد و خانه خلاق و نوآوری پژوهشگاه فرهنگ و اندیشه اسلامی در نظر دارد نشستهایی را تحت عنوان کارگاه دانشافزایی هوش مصنوعی برگزار نماید. اولین جلسه از این کارگاه علمی- آموزشی که حول موضوع اخلاق هوش مصنوعی بود، در تاریخ دوشنبه ۲۹ خردادماه سال جاری با عنوان «مروری بر معضل شکاف مسئولیت در هوش مصنوعی و راهکارهایی برای توسعه مسئولانه آن» و با حمایت مرکز تعاملات بینالمللی علم و فناوری معاونت علمی، فناوری و اقتصاد دانش بنیان ریاست جمهوری برگزار شد.

در این نشست دکتر سعیده بابایی پژوهشگر پسادکتری اخلاق هوش مصنوعی دانشگاه توبینگن آلمان و پژوهشگر گروه مطالعات اخلاقی پژوهشگاه فضای مجازی مسئله شکاف مسئولیت را صورتبندی و پاسخهایی را که به آن داده شده است، ارائه کرد.

این پاسخها به دو دسته کلی تقسیم میشدند: پاسخهایی که مسئولیت اخلاقی را به خود هوش مصنوعی واگذار میکنند و پاسخهایی که مسئولیت اعمال هوش مصنوعی را متوجه جامعه طراحان و کاربران میدانند. بابایی با تحلیل این پاسخها نشان داد تفاوت بنیادین در تعریف شرایط لازم و کافی مسئولیت، این بحث را به یک بنبست نظری کشانده است.

وی راهکار خروج از این بنبست را چرخش از تعبیر گذشتهنگر و منفعل از مسئولیت به تعبیر آیندهنگر و فعال دانست. پذیرش تعبیر فعال از مسئولیتپذیری موجب میشود به جای حلّ معضل شکاف مسئولیت، به دنبال منحل کردن آن باشیم. بهعبارتدیگر با ارائه راهبردهایی برای توسعه مسئولانه هوش مصنوعی، فرآیندهای توسعه را به گونهای طراحی کنیم که در هیچ شرایطی از عوامل انسانی سلب مسئولیت نشود.

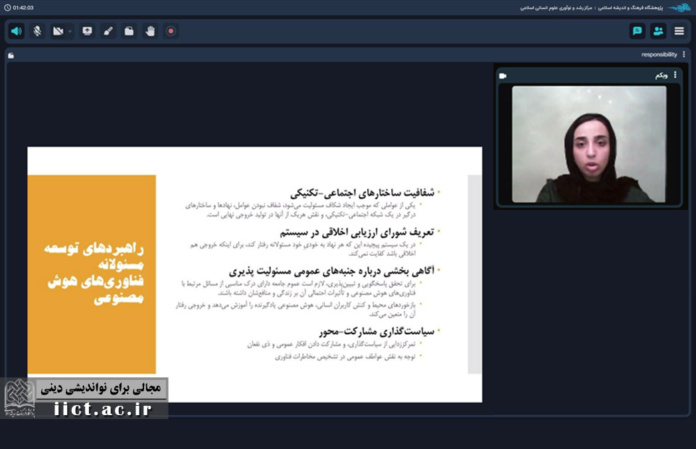

متخصص حوزه اخلاق هوش مصنوعی برای این منظور، چهار راهبرد در قالب راهبردهای توسعه مسئولانه هوش مصنوعی ارائه کرد که عبارت بودند از: شفافیت ساختارهای اجتماعی- تکنیکی، تشکیل شورای ارزیابی اخلاقی ناظر بر توسعه، آگاهیبخشی درباره ابعاد عمومی مسئولیتپذیری و سیاستگذاری مشارکت- محور.

وی سپس به توضیح مختصر هر یک از این راهبردهای مبنایی جهت پیشگیری از معضل شکاف مسئولیت پرداخت.